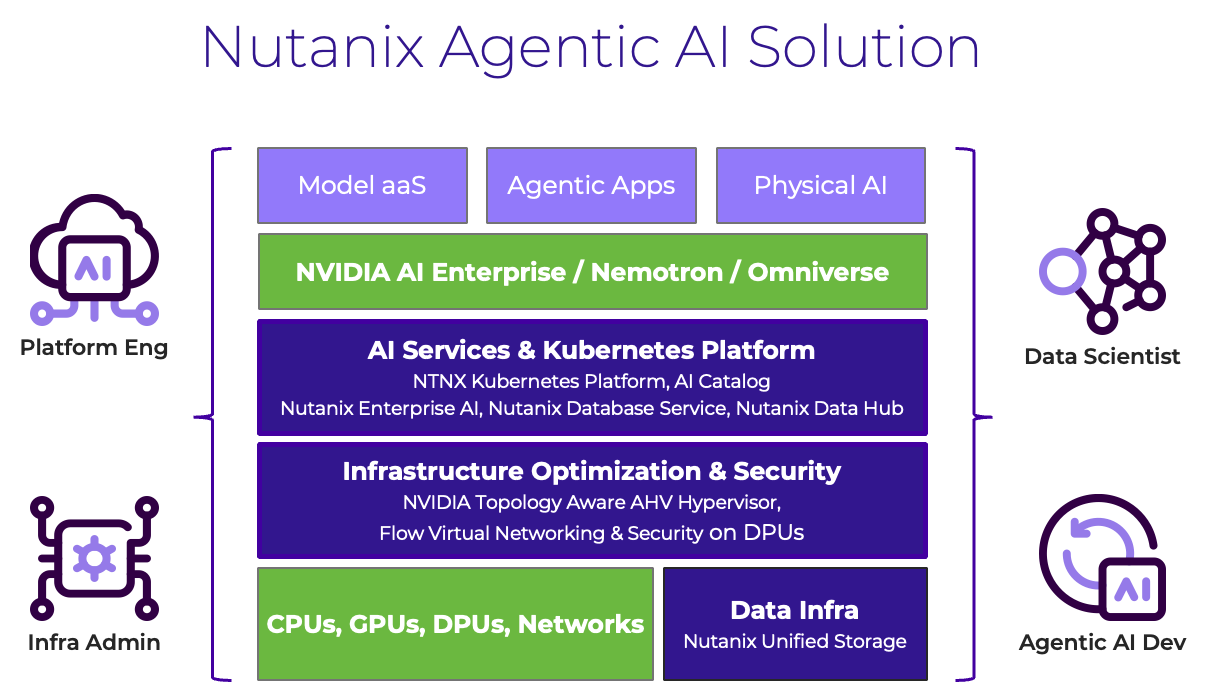

Nutanix Agentic AIソリューションは、複雑さを排除し、エージェント型AIビルダーとAIファクトリーのオペレーターの間にシームレスな架け橋を築きます。このフルスタック・ソリューションは、運用のシンプル化、パフォーマンスとセキュリティの最大化、そしてトークンコストの最適化を通じて、AI ファクトリーのオペレーターに「クラウド運用モデル」を提供します。同時に、エージェント型AIビルダーがインフラ管理から解放され、イノベーション、モデル管理、そして迅速な推論のスケーリングに専念できる環境を実現します。

エージェント型AI

AIファクトリーに必要な、実際に機能するインフラ

多くのAIプラットフォームは「大規模なAI」を謳いながらも、実際には「複雑性」をもたらしています。Nutanix Agentic AIは、組織がAIファクトリーを構築・運用・統制できるよう、クラウド運用モデルを提供するフルスタックのソフトウェアソリューションです。NVIDIAのアクセラレーテッドコンピューティングエコシステムとの統合により、運用をシンプル化し、パフォーマンスとセキュリティを最大化するとともに、GPU利用率とトークンコストを最適化します。

AIファクトリーのためのクラウド運用モデル

Nutanixは、AIファクトリーで稼働する「AIの同僚」の時代に合わせて特別に設計されたクラウド運用モデルを提供します。インフラの複雑性を排除し、IT意思決定者がパフォーマンス、セキュリティ、コストのバランスを最適化できるよう支援することで、Nutanix Agentic AIソリューションは単なる運用の簡素化に留まらず、AIの経済性そのものを根本から最適化します。

AIサービスとKubernetesプラットフォーム

高度なAI Gatewayと推論サービス

統合されたセキュアな推論エンドポイントにより、一貫した認証、可観測性、トークンベースのレート制限を維持しながら、クラウドホスト型モデル(およびトークンクレジット)をプライベートLLMと併用できます。

Model Context Protocol(MCP)のサポートとファインチューニング

Nutanix Enterprise AIは、既存の堅牢なModel-as-a-Service(MaaS)機能を拡張し、エージェントがエンタープライズツールやデータソースにセキュアに接続できるようにします。

豊富なAIカタログを備えたオープンなKubernetesプラットフォーム

Notebooks、ベクトルデータベース、MLOpsエンジンを含む、事前検証済みのオープンソースAIサービスカタログを使用し、インフラの遅延なしにエージェント型アプリケーションをコンセプトから本番環境へと移行できます。本ソリューションはNVIDIA AI Enterpriseとネイティブに統合されており、Nemotronを含むNVIDIA NIMを即座に展開して、本番環境での高性能なAIアプリケーション開発を加速できます。

インフラの最適化とセキュリティ

トポロジー認識型の最適化

Nutanix AHVハイパーバイザーは、GPU高密度サーバー間でのワークロード配置を自動的に最適化することで、手動による複雑なインフラチューニングを不要にし、最大限のパフォーマンス、セキュリティ、およびリソース利用率を確保します。

DPU加速によるゼロトラストネットワーキング

最新のDPUオフロード機能を備えたNutanix Flowを活用することで、仮想化環境の高度な隔離性を維持しつつベアメタルのスピードを実現。スループットを最大化し、AI ファクトリー全体でセキュアかつ信頼性の高いデータフローを確保する、高性能なゼロトラストネットワーク基盤を提供します。

エアギャップ環境のライフサイクル管理

本ソリューションは、NKPプラットフォーム全体、およびNVIDIA GPU/ネットワークオペレーターの完全なオフラインインストールをサポートしており、高度に規制された環境や防衛セクターにおいて、クラスターをインターネットにさらすことなくドライバーのアップデートやネットワークの最適化を自動化できます。

基盤となるAI向けデータサービス

リニアな拡張性

NVIDIAエンタープライズ認定のAIデータプラットフォームであるNutanix Unified Storage(NUS)は、数千のGPUクライアントにわたって高速な読み取り/書き込みパフォーマンスを提供し、コンピュートの拡張スピードに合わせたデータの可用性を保証します。

高度なスループット

NFS over RDMA、および近日対応予定のS3 over RDMAを活用することで、低レイテンシのデータパスを提供し、GPUがデータ不足に陥らないようにします。

コスト最適化

KVキャッシュのオフロード用に大容量層を提供することで、トークンあたりの総コストを削減し、重要なGPUメモリを解放します。これにより、パフォーマンスを低下させることなく、大幅に大規模なコンテキストウィンドウと、より多くの同時実行ユーザーの処理が可能になります。

Nutanix をご利用中のお客さまの声

関連製品

リソース

よくある質問

エージェント型AIビルダーは、インテリジェンスの構築に集中する代わりに、断片化したモデルやツール、データのサイロ化という複雑な環境に翻弄され、大きな「イノベーションの摩擦」に直面しています。開発者は、多様なLLMやオープンソースツールを統合し、単純なチャットUIから、実際のビジネス成果を導き出す高度なAIへと迅速に進化させるための、統一されたセキュアな経路を必要としています。

一方、AIファクトリーのオペレーターにとっての最大の課題は、以下のような運用の複雑さにより、「価値創出までの時間」や「トークンあたりのコスト」で測定されるビジネス価値を提供することです。

- 多様化・高速化するハードウェア管理: 急速に進化するGPU、ネットワーキング、ストレージの管理

- 共有とセキュリティの両立: 重要なAIインフラへの共有アクセスを提供しつつ、モデルやデータへのセキュアなアクセスを確保し、データ主権(デジタルソブリン)要件を遵守する困難さ

- リソースの最適化: AIファクトリー全体でリソース利用率を最適化しながら、常に最大のパフォーマンスを維持する複雑性

- ライフサイクル管理: AIファクトリーの運用を支える、断片的で特注の個別ソリューションのライフサイクル管理の複雑さ

Nutanixの「クラウド運用モデル」は、AI開発者とインフラチームのギャップを埋めるためのアプローチです。断片化したポイントソリューションや複雑なベアメタル・クラスターを管理する代わりに、統一されたフルスタック環境を提供します。これにより、オペレーターはAIインフラ(GPU、DPU、ストレージ)をクラウドサービスのような手軽さで統制でき、開発者は数千ものインテリジェント・エージェントを拡張するために必要なツールやモデルへ、即座にセキュアにアクセスできるようになります。

Nutanixは、以下の統合された効率化メカニズムを通じてトークンエコノミクスを最適化します。

- トポロジー認識型の最適化: Nutanix AHVハイパーバイザーが、GPU高密度サーバー間でのワークロード配置を自動的に行い、ハードウェアの整合性を最大化します。

- リソースのオフロード: DPU(データ・プロセッシング・ユニット)を使用してネットワークやセキュリティタスクを処理することで、GPUのリソースを推論専用に解放します。

- スマートなストレージ活用: Nutanix Unified Storage(NUS)がKVキャッシュのオフロード用に大容量層を提供。高価なGPUメモリを節約し、パフォーマンスを損なうことなく大規模なコンテキストウィンドウの処理を可能にします。

初期のモデルトレーニングにはベアメタルが標準的でしたが、企業がエージェントを大規模に展開するには、セキュリティや隔離性が不十分な場合があります。Nutanixは、仮想マシン(VM)ベースのKubernetesインフラを採用することで、以下を提供します。

- 優れた隔離性: 異なるAIワークロード間での強固なマルチテナント環境とセキュリティ境界を確立します。

- 大規模な管理性: ライフサイクル管理やリソース割り当てを容易にします。

- ベアメタル級のパフォーマンス: DPUによる加速とトポロジー認識機能を活用することで、仮想化環境のガバナンスを維持しつつ、ベアメタルに匹敵するスピードを実現します。

Nutanix Enterprise AI(NAI)Gatewayは、すべてのAIモデルに対するセキュアなフロントドアとして機能します。統合された推論エンドポイントを提供し、クラウドホスト型モデルとプライベートLLMを一箇所で管理できます。主な特長は以下のとおりです:

- ガバナンス: トークンベースのレート制限により、予期せぬコスト増(ビルショック)を防止します。

- 可観測性 : 「誰が」「どのように」リソースを消費しているかを完全に可視化します。

- 接続性 : Model Context Protocol(MCP)をサポートし、エージェントが企業のプライベートデータやツールへセキュアに接続することを可能にします。

インフラのセットアップをバイパスできる開発者中心の環境を提供することで、イノベーションを加速させます。Nutanix Kubernetes Platform(NKP)を通じて、ビルダーは以下を含む豊富なAIカタログにアクセスできます。

- 構築済みのオープンソースツール: Notebooks、ベクトルデータベース、MLOpsエンジンなど。

- 即時の展開: NVIDIA NIMやNVIDIA Nemotronファミリーのモデルを迅速に利用可能。

- 1クリックの利便性: セキュアな推論エンドポイントの1クリック提供や、ファインチューニング・サービスへのターンキーアクセス。

Nutanix Unified Storage(NUS)は、AIや次世代アプリケーションなどのモダンなワークロード向けに専用設計された、スケーラブルで高性能なデータプラットフォームです。以下の主な機能が含まれます:

- 圧倒的なスループット: 超高速な読み取りスループットと高密度なオールNVMe構成により、推論や検索拡張生成(RAG)を含むAIパイプラインの膨大なデータセットに対応します。

- NKPとの統合: Nutanix Kubernetes Platformと連携し、コンテナ化されたAI/MLパイプラインやクラウドネイティブアプリのシームレスな展開を実現します。

- マルチプロトコル対応: 多様なワークロードのストレージをシンプル化し、イノベーションを加速させます。